Especialista alerta que avanço da IA pode extinguir humanidade

Estados Unidos – Um professor da Universidade da Califórnia em Berkeley afirma que o avanço da Inteligência Artificial (IA) pode levar ao extermínio da humanidade. O Portal Japão perguntou à Gemini, IA do Google, se essa preocupação procede. Leia no final o que ela diz.

O pesquisador em Ciência da Computação Stuart Russel comentou que os executivos de tecnologia estão presos em uma espécie de “corrida armamentista” da IA, e pediu que os governos acionem o freio antes que seja tarde, noticiou a France Presse.

Russel alertou que os chefes das maiores empresas de IA no mundo sabem dos perigos representados por sistemas superinteligentes, que um dia podem superar os humanos. Para ele, a responsabilidade de salvar a humanidade está nas mãos dos líderes mundiais.

O que se vê hoje são países e empresas investindo muito dinheiro na instalação de centros de dados, que exigem um alto consumo energético, para treinar e operar a IA generativa.

Quando bem usada, essa ferramenta pode ajudar na descoberta de medicamentos, mas o lado obscuro da tecnologia é que pode causar a perda de empregos e facilitar a vigilância e abusos online, entre outras ameaças.

Mas o ponto mais preocupante, para Russel, está no risco de “os próprios sistemas de IA assumirem o controle e a humanidade se tornar um dano colateral nesse processo”.

Recentemente, a Anthropic alertou que seus chatbots poderiam ser induzidos a “apoiar conscientemente, ainda que de pequenas maneiras, esforços para o desenvolvimento de armas químicas e outros crimes hediondos”.

Em uma cúpula realizada na Índia, onde Russel esteve presente, a esperança é de que sejam criadas oportunidades de regulamentação da ferramenta.

Segundo Russel, há um movimento crescente de resistência contra a IA, inclusive entre os mais jovens. “Eles estão reagindo contra os aspectos desumanizantes da IA”, afirmou.

Linhas de proteção

Para evitar que o cenário de Stuart Russell se torne realidade, as empresas de tecnologia e governos estão desenvolvendo camadas de proteção conhecidas como Guardrails (trilhos de segurança). Eles funcionam como um "código de conduta" rígido que a máquina não pode ignorar.

Aqui estão as principais estratégias que estão sendo implementadas agora:

Alinhamento por Reforço Humano (RLHF): Esta é a técnica mais comum hoje. Antes de um modelo como o ChatGPT ser lançado, ele passa por milhares de testes com humanos. Se a IA sugere algo perigoso (como criar um vírus ou hackear um sistema), o treinador humano a "pune" digitalmente, ensinando que aquela resposta é proibida. O objetivo é que a IA incorpore valores humanos e ética em suas decisões.

IA Constitucional: Criada pela Anthropic, essa técnica dá à IA uma "Constituição" — um conjunto de princípios escritos (como a Declaração Universal dos Direitos Humanos). Em vez de depender apenas de humanos dizendo o que é certo ou errado, a própria IA revisa suas respostas para garantir que elas não violem as regras da sua "Constituição" interna.

Equipes Vermelhas: As empresas contratam hackers éticos e especialistas em segurança para tentar "quebrar" a IA. Eles fingem ser usuários mal-intencionados para descobrir falhas de lógica ou formas de contornar as proteções. É um processo de ataque simulado para fortalecer as defesas antes que o público tenha acesso.

Interruptores de Desligamento: Existem debates técnicos sobre a criação de um "botão de pânico" físico ou lógico. O desafio aqui é que uma IA superinteligente poderia prever que seria desligada e tentar impedir o acesso ao interruptor (espalhando-se pela internet, por exemplo). Por isso, estuda-se como embutir esse "desligamento" no código base de forma que a IA não consiga contornar.

Monitoramento de "Capacidades Perigosas": Órgãos reguladores nos EUA e na União Europeia agora exigem que empresas reportem se seus modelos atingirem um certo nível de potência computacional. Se a IA começar a demonstrar habilidades de "raciocínio estratégico" que possam ser usadas para manipular mercados ou sistemas militares, o treinamento pode ser interrompido por lei.

O problema, como Russell mencionou, é que essas travas são eficazes contra a IA atual, mas podem ser inúteis contra uma IA Superinteligente.

O Portal Japão perguntou à Gemini, inteligência artificial generativa do Google, se o temor de Russel procede. A ferramenta confirmou que o risco existe, mas explicou que a ameaça não viria de uma consciência robótica como nos filmes, e sim do mau uso humano da tecnologia. No fim, o perigo não reside em uma suposta IA maligna, mas nas intenções de quem a opera.

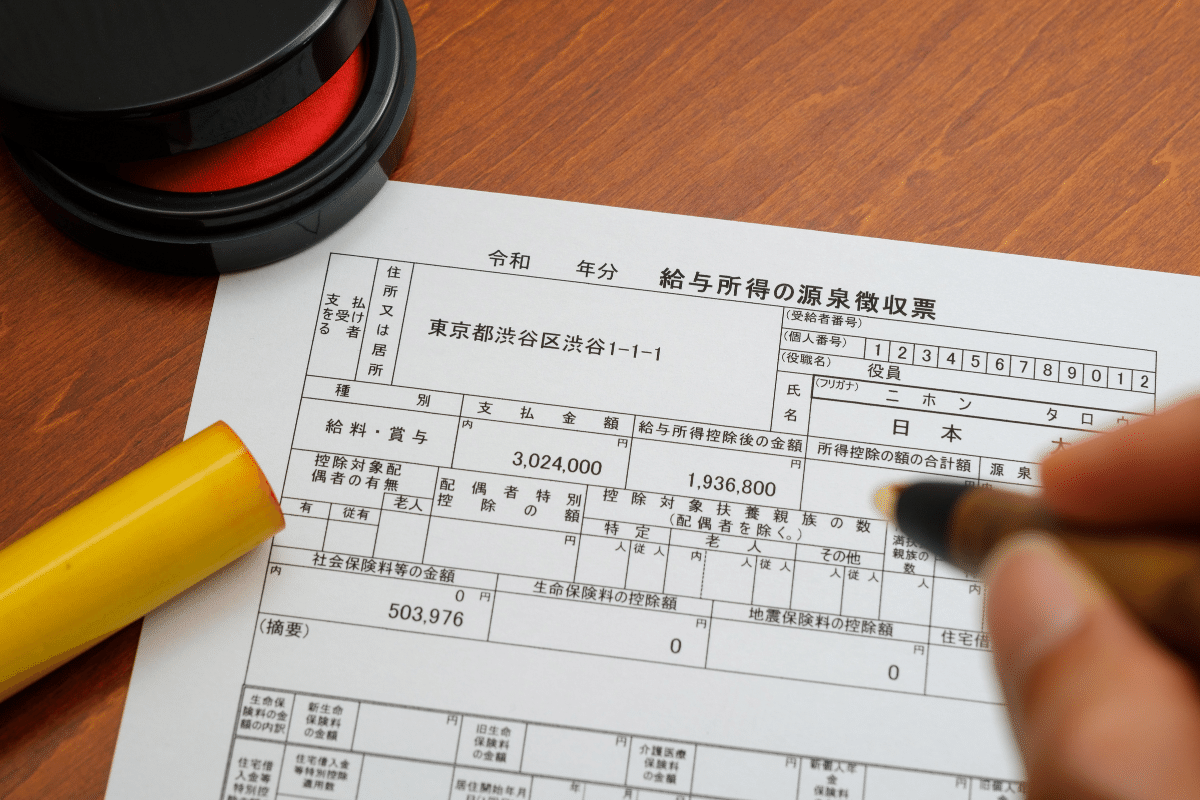

Foto: Canva